La Paradoja de la Competencia

Las herramientas que le hacen mejor en la tarea también le hacen peor sin la herramienta. Esto no es una teoría. Es un fenómeno documentado con cuarenta años de investigación, observado en cada ámbito donde se ha introducido la IA o la automatización.

La evidencia clínica más clara hasta la fecha proviene de la gastroenterología. Un estudio de Budzyn y colegas, publicado en The Lancet Gastroenterology & Hepatology en 2025, hizo seguimiento a médicos que trabajaban con sistemas de colonoscopia asistidos por IA. Tras doce meses, los médicos detectaban menos pólipos al trabajar sin IA que antes de que se introdujera la asistencia de IA. La herramienta mejoró el sistema. La herramienta degradó al humano.

El patrón se extiende mucho más allá de la medicina. En aviación, los informes de la NASA y la FAA documentan un hallazgo persistente: los pilotos que dependen de sistemas de piloto automático durante períodos prolongados muestran una degradación medible en las habilidades de vuelo manual. En ingeniería de software, un análisis de GitClear reveló que la rotación de código se duplicó entre 2022 y 2024, correlacionándose directamente con la adopción de herramientas de codificación con IA.

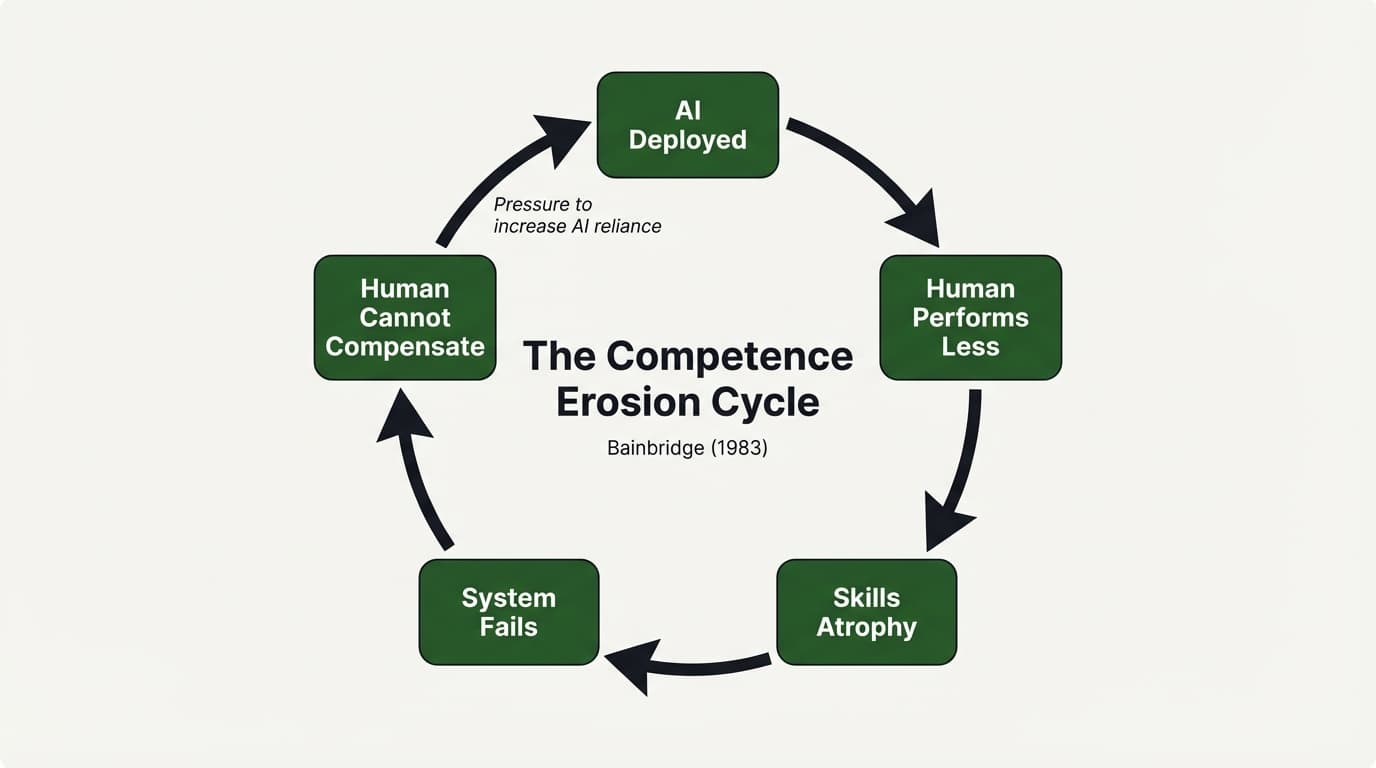

Lisanne Bainbridge identificó esta dinámica en 1983, en un artículo titulado "Ironías de la Automatización" que desde entonces ha acumulado más de 4.700 citas. Bainbridge demostró que cuanto más fiable se vuelve un sistema automatizado, menos hábiles se vuelven sus operadores humanos para detectar cuándo el sistema falla.

El ciclo de erosión se autoalimenta. La asistencia de IA reduce la necesidad de práctica manual. La práctica reducida degrada la habilidad subyacente. La habilidad degradada aumenta la dependencia de la herramienta. Y la mayor dependencia reduce aún más la práctica. El bucle se estrecha con cada iteración.

Treinta años es demasiado

Los datos de las encuestas a directivos son inequívocos. En febrero de 2026, un estudio de Fortune y NBER con casi seis mil ejecutivos reveló que el noventa por ciento no había observado ningún impacto medible en la productividad derivado de sus inversiones en IA. No impacto negativo — ningún impacto. La tecnología más ampliamente desplegada de la década, según la evaluación de sus propios usuarios, no está produciendo nada.

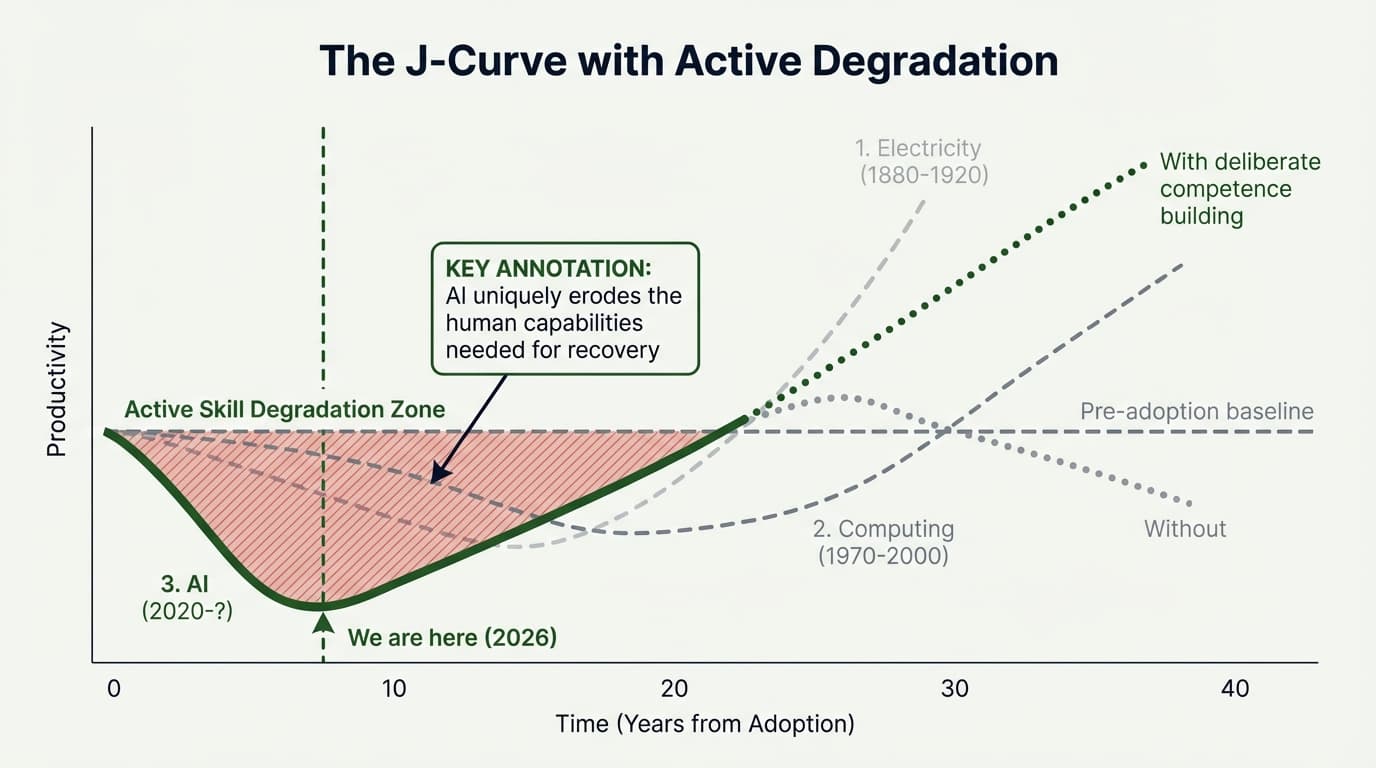

Esta es la versión IA de un patrón que ya se ha repetido antes. El historiador económico Paul David demostró en un artículo de 1990 que la electricidad tardó más de treinta años en producir las ganancias de productividad prometidas — no porque la tecnología fuera lenta, sino porque las organizaciones tuvieron que reconstruir sus instalaciones físicas, prácticas de gestión y habilidades de la plantilla antes de poder materializar el potencial.

Robert Solow capturó el mismo desfase para la informática en 1987: "Se puede ver la era del ordenador en todas partes menos en las estadísticas de productividad." El marco de la Curva J de Erik Brynjolfsson explica el mecanismo. Cuando las organizaciones adoptan una tecnología transformadora, la productividad medida inicialmente disminuye porque las ganancias reales requieren inversiones costosas y prolongadas en rediseño organizacional y capital humano.

Pero hay una diferencia crítica entre la transición a la IA y todas las transiciones tecnológicas anteriores. La electricidad no hizo que los trabajadores de las fábricas olvidaran cómo usar las manos. La informática no degradó la capacidad de los contables para razonar sobre números. La IA erosiona activamente las competencias que automatiza. La Curva J es más profunda que nunca.

Las organizaciones que entienden esto — que la transición a la IA requiere no solo nueva tecnología sino inversión deliberada en competencia humana — no esperarán treinta años. Se reorganizarán ahora, mientras la competencia aún existe para ser preservada.

El TwinLadder

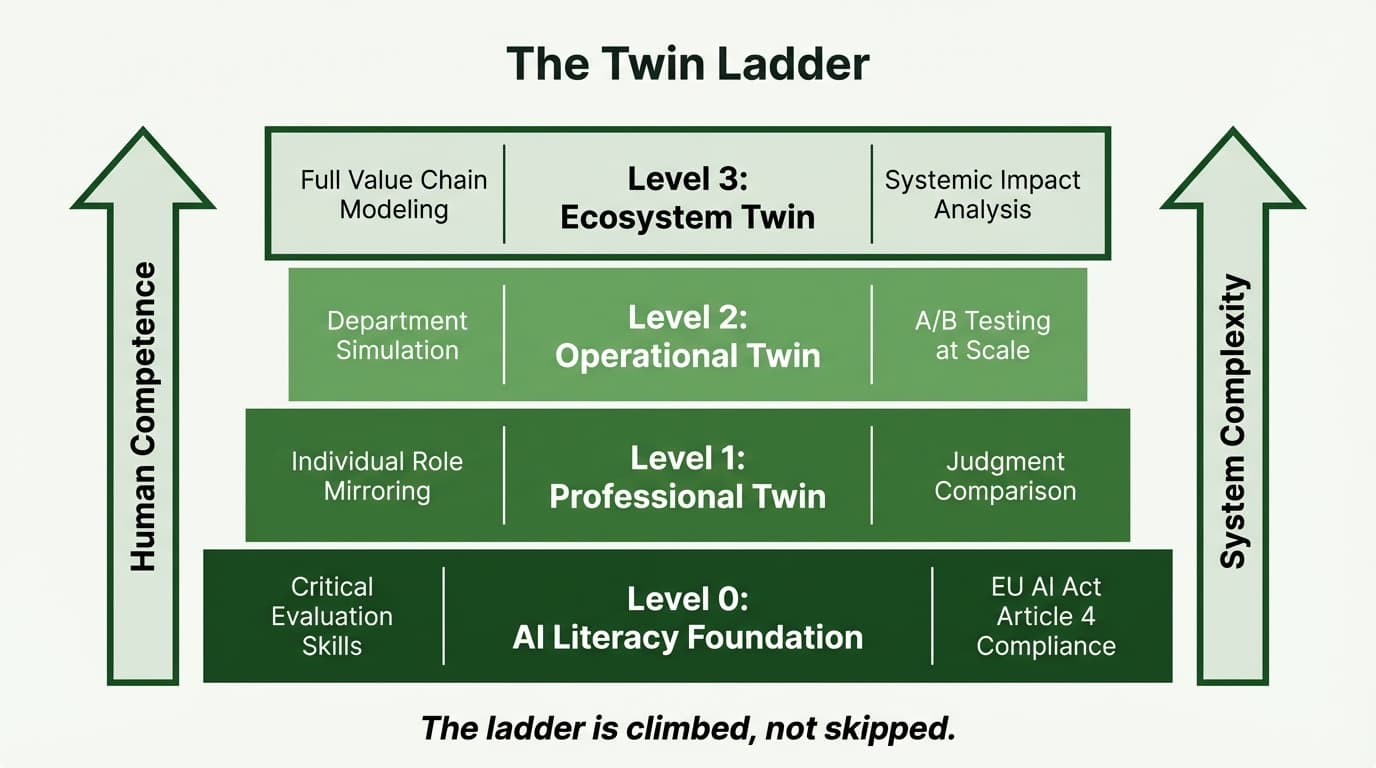

El TwinLadder es una progresión de cuatro niveles para construir competencia en IA desde el individuo hasta el ecosistema. Aborda la paradoja de la competencia no ralentizando la adopción de IA, sino asegurando que las personas que trabajan junto a la IA mantengan y profundicen su criterio profesional.

El punto de partida

La capacidad básica de evaluar críticamente los resultados de la IA. Aquí es donde todo comienza, y sin ella, cada nivel posterior está construido sobre arena. ¿Puede su equipo distinguir un buen resultado de un sinsentido convincente?

Se corresponde directamente con el Artículo 4 de la Ley de IA de la UE, que exige una "alfabetización suficiente en IA" para todo el personal que interactúa con sistemas de IA. La aplicación comienza en agosto de 2026.

Reflejar, comparar, crecer

Un agente de IA refleja un rol individual — no para sustituir, sino para comparar. El profesional ve lo que la IA produce para su dominio específico y aprende de la diferencia entre su criterio y el resultado de la máquina.

La interfaz de predicción primero: el profesional hace su propia evaluación antes de ver la recomendación de la IA. El aprendizaje está en la diferencia.

Probar antes de comprometerse

Réplicas digitales de departamentos, cadenas de suministro o unidades de negocio. Las organizaciones pueden realizar pruebas A/B con configuraciones alternativas antes de comprometer recursos. La disciplina clave es garantizar que los responsables de las decisiones comprendan por qué un enfoque supera al otro, no simplemente que lo hace.

Configurar las reglas

Agentes de IA multientidad que representan entornos regulatorios, dinámicas de mercado y ecosistemas competitivos. Para sectores como energía, finanzas y sanidad donde las regulaciones coevolucionan con la tecnología que regulan.

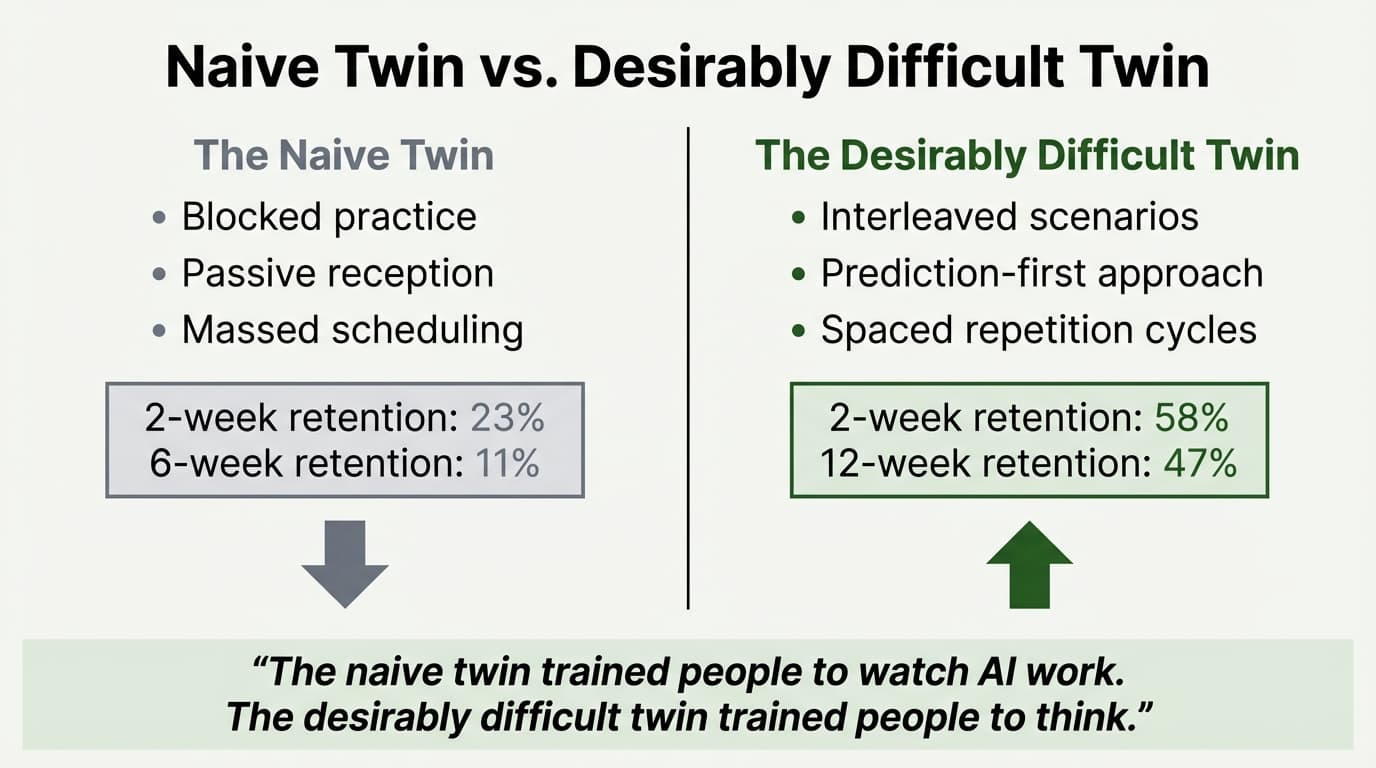

La ciencia: Dificultades deseables

La investigación de Robert Bjork sobre las dificultades deseables se encuentra entre los hallazgos más replicados de la ciencia cognitiva. La idea central es contraintuitiva: las condiciones de aprendizaje que empeoran el rendimiento durante la formación mejoran el rendimiento a largo plazo. La incomodidad es el mecanismo, no un defecto que deba optimizarse.

Décadas de investigación de Anders Ericsson sobre la práctica deliberada cuentan la misma historia desde otro ángulo. La experiencia requiere un compromiso activo y sostenido con tareas progresivamente difíciles — tareas que extienden la capacidad actual en lugar de confirmarla.

La IA elimina sistemáticamente la dificultad del trabajo profesional. Elimina la fricción, la lucha, el fracaso repetido que consolida la comprensión. Al hacerlo, elimina el mecanismo por el cual la experiencia siempre se ha construido.

Se formó a las personas para observar cómo trabaja la IA.

Se formó a las personas para pensar junto a la IA.

Este es el principio de diseño detrás de cada proyecto de TwinLadder: preservar las dificultades deseables incluso cuando la IA se encarga del trabajo rutinario.

¿Dónde se sitúa su organización?

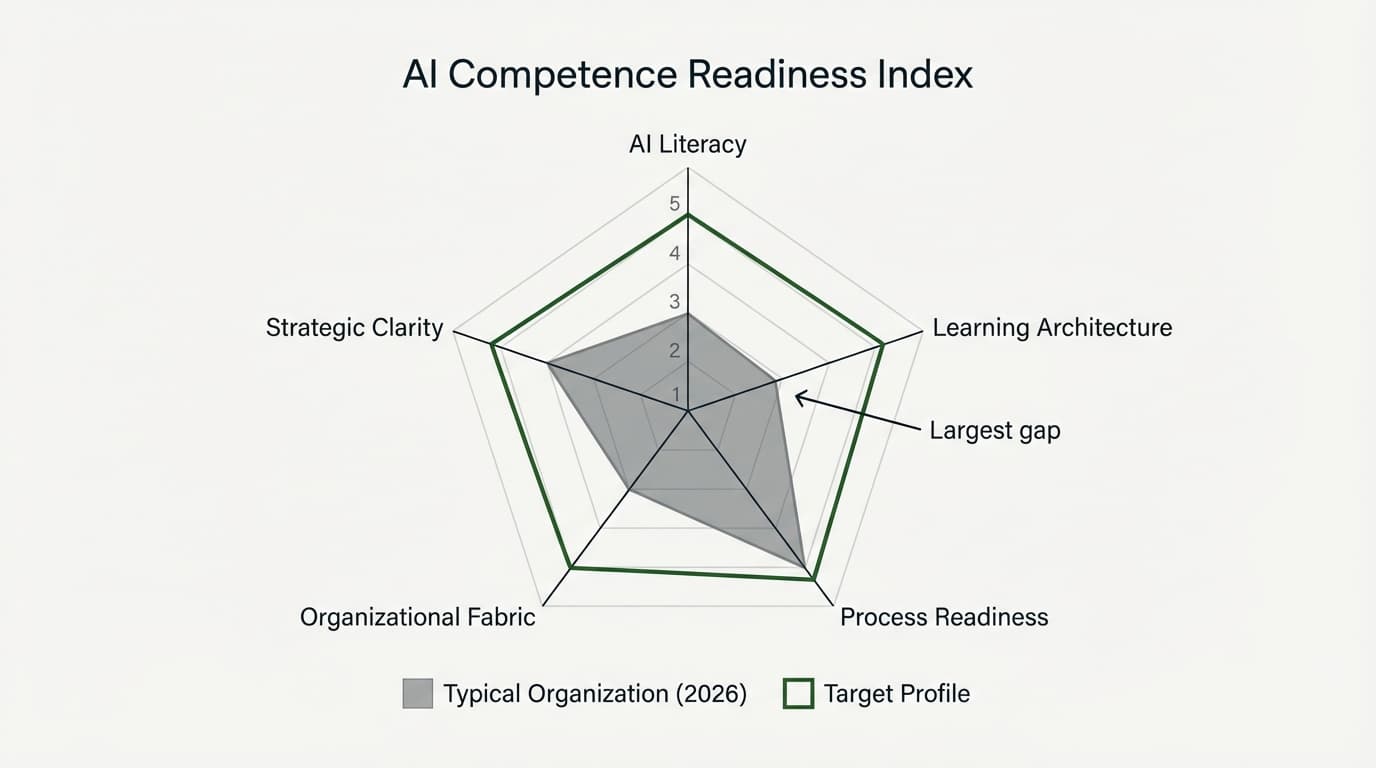

El Índice de Preparación en Competencia de IA mide cinco dimensiones de la preparación organizacional. No su capacidad para desplegar herramientas de IA — la mayoría de las organizaciones la tienen — sino su capacidad para desarrollar la competencia humana necesaria para usarlas bien.

La mayoría de las organizaciones obtienen actualmente entre 8 y 14 de 25 puntos. El perfil típico es revelador: puntuaciones moderadas en Alfabetización en IA y Preparación de Procesos, pero puntuaciones bajas en Infraestructura de Aprendizaje y Preservación de Competencias — las dimensiones que más importan para la capacidad a largo plazo.

He aquí una prueba que puede realizar esta semana. Pida a cinco personas de su equipo que evalúen el mismo trabajo generado por IA — un informe, una recomendación, un borrador de análisis. No les diga que fue generado por IA. Pídales que valoren su calidad, identifiquen sus puntos débiles y decidan si actuarían en consecuencia. Si la variabilidad en sus evaluaciones es baja y la calidad de sus críticas es alta, su organización está más avanzada que la mayoría. Si la variabilidad es alta y las críticas son superficiales, esa es su puntuación de preparación.

Qué hacer el lunes por la mañana

Tres acciones. Un día. Sin presupuesto. Sin tecnología. Sin consultor externo. Son herramientas de diagnóstico, no soluciones — pero le dirán más sobre la preparación real de su organización en IA que cualquier evaluación de proveedor.

Evalúe la capacidad de su equipo para valorar resultados de IA

Pida a cinco personas de su equipo que evalúen el mismo trabajo generado por IA — un informe, una recomendación, un borrador de análisis. No les diga que fue generado por IA. Pídales que valoren su calidad, identifiquen sus puntos débiles y decidan si actuarían en consecuencia. La variabilidad en sus respuestas le dirá más que cualquier encuesta de preparación.

Mapee un proceso modificado por la IA y compruebe si hay erosión de criterio

Identifique un proceso que la IA haya cambiado sustancialmente en los últimos doce meses. Encuentre a las personas que solían tomar las decisiones clave en ese proceso. Pregúnteles directamente: ¿entiende usted todavía por qué el sistema toma las decisiones que toma? ¿Sabría si se equivoca? ¿Cómo lo sabría?

Cuente las interacciones que desaparecieron

Determine cuántas reuniones interfuncionales, consultas informales o sesiones de colaboración han sido sustituidas por informes automatizados, resúmenes de IA o paneles de control en los últimos seis meses. Pregúntese si la calidad de la información mejoró o si algo se perdió en la traducción.

Estas tres acciones no requieren presupuesto, ni tecnología, ni consultor externo. Solo requieren la voluntad de hacer preguntas incómodas y la honestidad de escuchar las respuestas.

Ley de IA de la UE, Artículo 4

El Artículo 4 de la Ley de IA de la UE entró en vigor en febrero de 2025. La aplicación comienza en agosto de 2026. La disposición exige un "nivel suficiente de alfabetización en IA" para todo el personal que interactúa con sistemas de IA — un mandato deliberadamente amplio que abarca prácticamente a todos los trabajadores del conocimiento en toda organización que despliega herramientas de IA.

El Nivel 0 de TwinLadder — la Base de Alfabetización en IA — se corresponde directamente con el cumplimiento sustantivo del Artículo 4. No porque el cumplimiento normativo fuera el objetivo de diseño, sino porque el requisito subyacente es el mismo: las personas que trabajan con sistemas de IA deben comprender qué pueden hacer esos sistemas, qué no pueden hacer y cómo evaluar críticamente sus resultados.

Iniciemos una conversación.

Qué sucede con la competencia humana cuando la IA realiza el trabajo que la construyó. Esa es la cuestión en la que estamos trabajando. Si usted es un líder que intenta comprender qué significa eso para su organización — no teóricamente, sino en la práctica — nos gustaría saber de usted.

AI Competence for Organizations

A comprehensive guide to building organisation-wide AI competence beyond Article 4 compliance.

Download PDFAI Competence for Legal Professionals

How legal teams can build systematic AI competence while managing professional liability.

Download PDFAI Competence for HR Professionals

Coming soon — preparing your workforce for AI transformation.

Coming Soon